StepFun AI 推出开源音频编辑模型 Step-Audio-EditX,实现音频编辑新体验

2025年11月10日 10:46·AIBase

音频编辑新突破:Step-Audio-EditX模型让语音控制更精准

StepFun AI最新开源模型彻底改变音频编辑方式,将复杂语音编辑转化为直观的令牌操作,实现前所未有的控制精度。

音频编辑的革命性进步

StepFun AI近日发布开源音频编辑模型Step-Audio-EditX。

这个3B参数模型让音频编辑变得像文本编辑一样简单。

通过将音频信号转换为令牌操作,语音编辑变得更加直观可控。

传统语音合成的局限性

当前零样本文本转语音系统存在明显不足。

它们在情感、风格和音色控制上表现有限。

虽然能生成自然语音,但往往无法精确满足用户需求。

Step-Audio-EditX通过创新方法解决了这一难题。

创新技术架构解析

模型采用双代码本标记器技术。

语音被映射为两个独立令牌流:

- 语言流:以16.7Hz速率记录语音内容

- 语义流:以25Hz速率捕捉语义信息

这种设计让模型能同时处理文本和音频令牌。

先进训练方法

模型采用大边距学习方法提升性能。

训练使用合成三元组和四元组数据增强表现。

基于6万名说话者的高质量数据进行训练。

结合人类评分数据进行强化学习优化。

严谨的性能评估

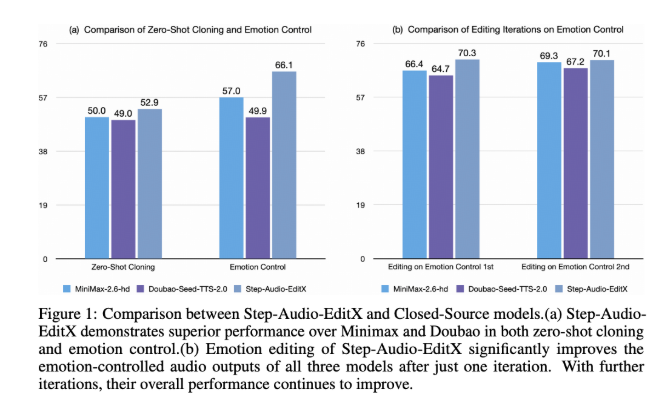

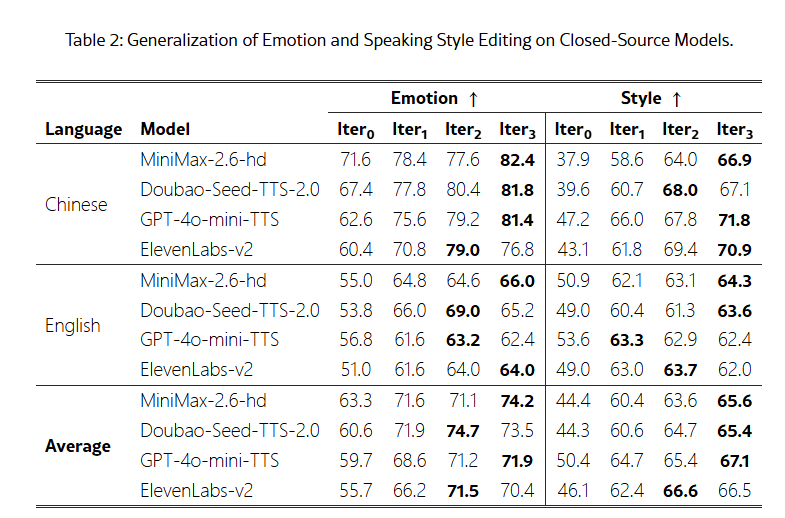

研究团队引入Step-Audio-Edit-Test基准。

使用Gemini2.5Pro作为评估工具。

测试显示模型在情感和风格准确性上显著提升。

该模型还能提升其他TTS系统的音频质量。

核心亮点总结

🎤 Step-Audio-EditX模型 - 重新定义音频编辑体验

📈 大边距学习技术 - 显著提升编辑精度

🔍 专业评估基准 - 确保音频质量优化